如何在Google Colab上运行Ollama(一种程序)

在人工智能和机器学习快速发展的背景下,大型语言模型(LLM)变得越来越流行和强大起来。然而,本地运行这些模型通常需要大量的计算资源,这些资源可能不是每个人都能轻易获得。这时,Google Colab 和 Ollama 就可以派上用场了,提供了一种解决方案,让使用者能够利用大型语言模型的强大功能,而不需要昂贵的硬件。在本指南中,我们将在此指南中一步步教你如何在 Google Colab 上运行 Ollama,让您能够一步步利用这些前沿技术。

在我们开始之前,让我们谈谈我们在开发过程中都会遇到的一个话题:使用Postman进行API测试以帮助您的开发团队。

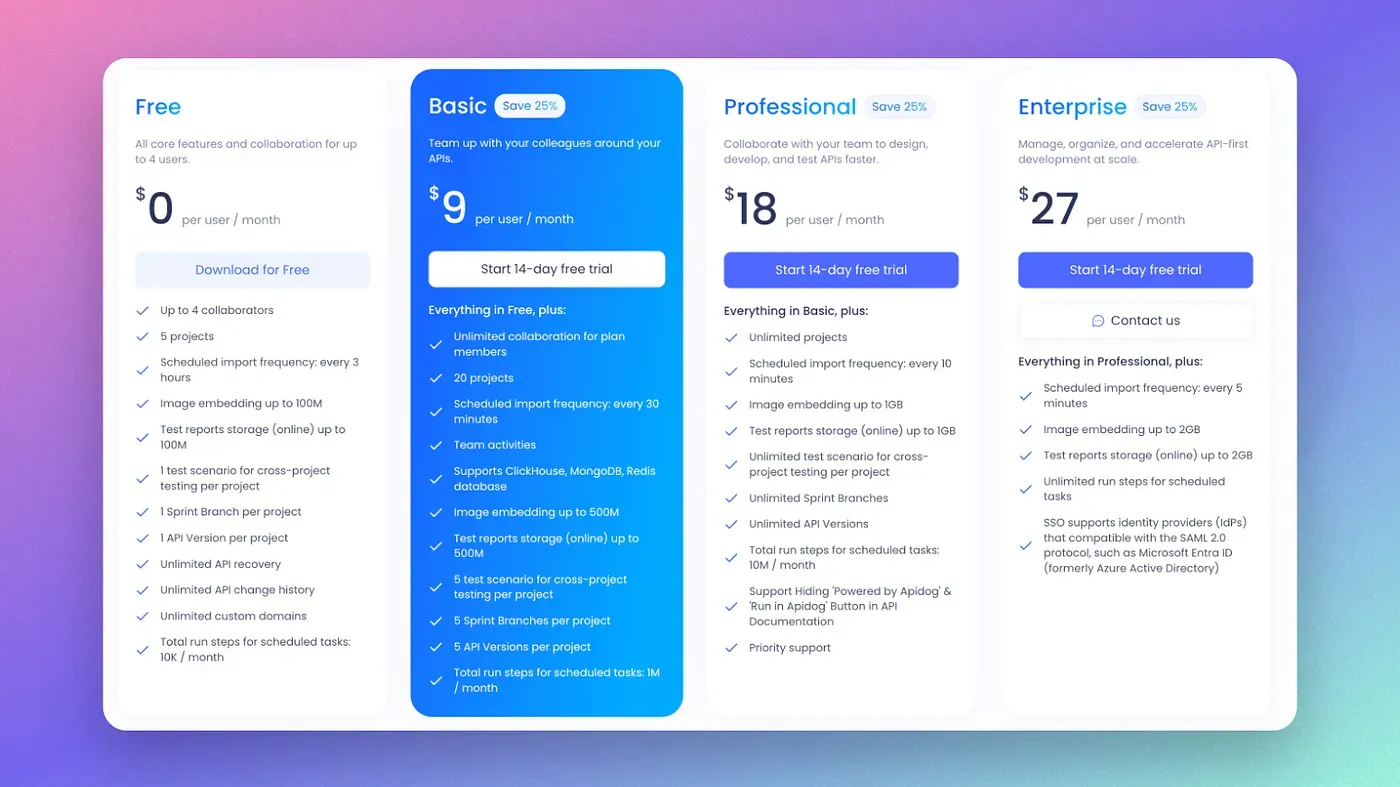

是的,我也听说过,Postman 的情况一年比一年差,但你是在团队中工作,你们需要一些协作工具来帮助开发流程,是吧?所以你们每个月为 Postman Enterprise 支付了……49 美元(每月)。

我现在告诉你:你不必

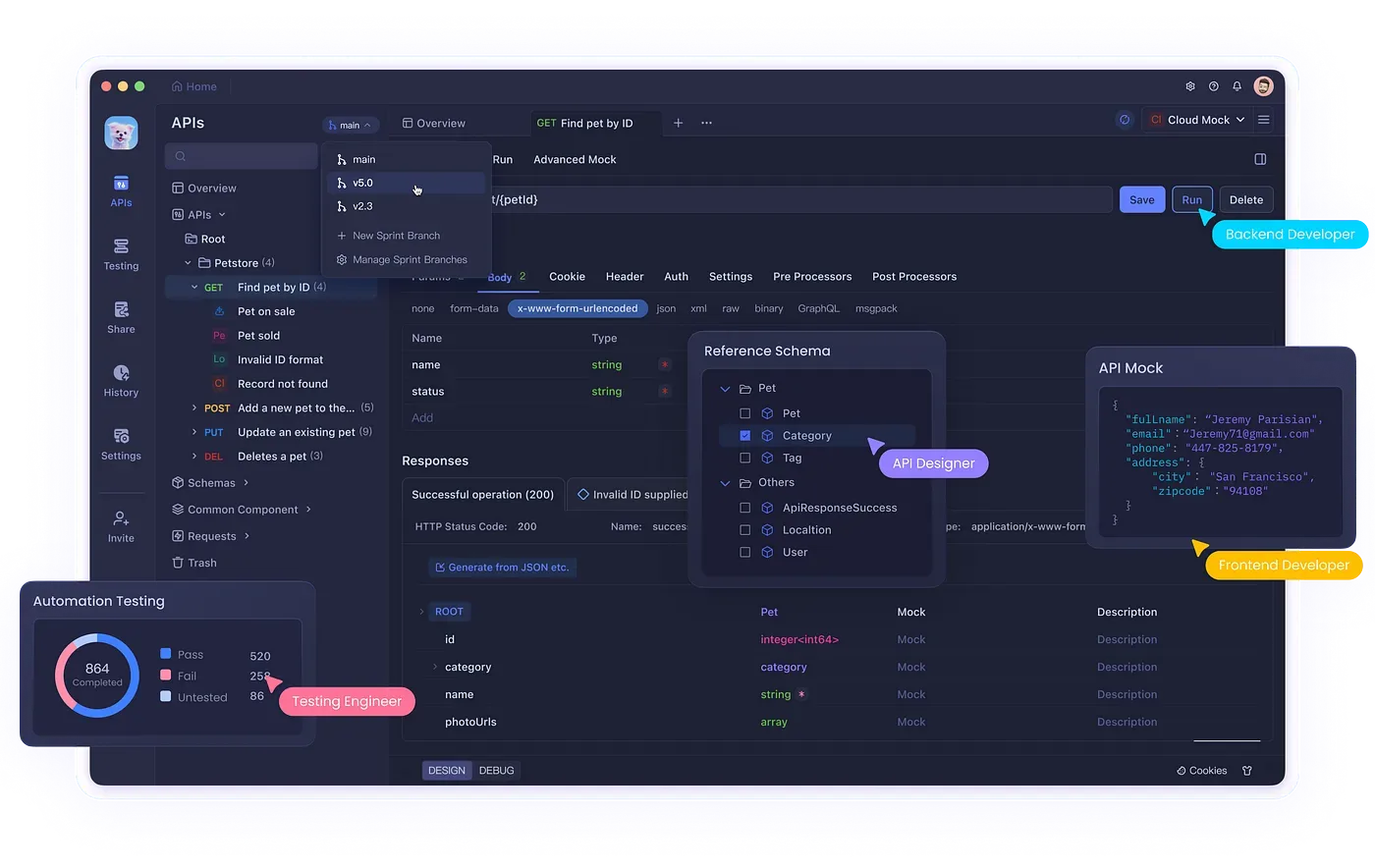

确实如此,APIDog 提供与 Postman 付费版本相同的所有功能,成本却低得多。迁移简直不要太简单,只需点几下,APIDog 就会帮你搞定一切。

如何将 Postman 的集合和环境迁移到 ApidogPostman 是最广泛使用的全球 API 调试工具。然而,它存在不少缺点。下面我们将探讨……bit.lyAPIDog 拥有一个全面且易于使用的图形界面,让你马上上手(如果你是从 Postman 迁移过来的)。它简洁优雅、易于协作和使用,还有暗黑模式哦!

想要找一个比 Postman 更好的替代品吗?APIDog 绝对值得一试哦。但如果你是某个开发团队的技术主管,真的想换掉 Postman,寻找一个更好的、更便宜的替代方案,可以试试 APIDog 哦!

Apidog 一站式API设计、调试、开发、仿真和测试平台真正的API设计先行平台。设计、调试、测试、文档、仿真,更快地一起构建APIs。在开始设置之前,了解Ollama和Google Colab的含义以及为什么它们在处理LLM时很有用非常重要。

你知道Ollama是什么吗?它是一个...(简单描述一下)Ollama 是一个开源项目,旨在简化本地运行大型语言模型的过程。它提供了一个用户友好的界面,用于下载、运行和管理各种 LLM,例如 Llama 2 和 GPT-J 等流行模型。Ollama 的主要目标是让这些强大的模型更容易被开发人员和研究人员使用,即使他们没有高端硬件的支持。

Google Colab是什么?Google Colab,简称Google Colaboratory,是一个免费的云端平台,允许用户通过浏览器编写和执行Python代码。它提供了包括GPU和TPU在内的强大计算资源,是机器学习和数据科学项目理想的环境。类似于Jupyter笔记本,但Colab笔记本是在云端托管的,省去了本地安装和配置的麻烦。

Google Colab上运行Ollama的好处把 Ollama 和 Google Colab 结合起来使用可以带来很多好处:

- 免费访问强大的GPU:Google Colab提供免费访问GPU,这对于高效运行大型语言模型至关重要。

- 无需本地安装:您无需在本地安装任何内容即可运行Ollama,只需使用任何带有网络浏览器的设备即可。

- 协作环境:Colab笔记本可以轻松共享和协作,非常适合团队协作或教育用途。

- 灵活性:您可以在不同的Ollama模型之间轻松切换并尝试各种配置,而无需担心本地资源限制。

现在我们知道了这些好处,让我们一步步在Google Colab上设置并运行Ollama。

第一步:创建一个新的Colab笔记本(一种云端编程环境)- 打开Google Colab网站(colab.research.google.com)。

- 点击“新建笔记本”来创建一个新的Colab。

在你的笔记本中,我们将首先在笔记本的第一个单元格中安装所需的软件包。

!pip install colab-xterm # 安装 colab-xterm 扩展

%load_ext colabxterm # 加载 colabxterm 扩展这会安装 colab-xterm 包,让我们可以在 Colab 笔记本中使用终端。

要在你的Colab笔记本中打开终端窗口,请在一个新的单元格中运行下面的命令。

%xterm(终端模拟器)这将在你的笔记本中打开一个终端界面窗口,让你可以直接运行 shell 命令。

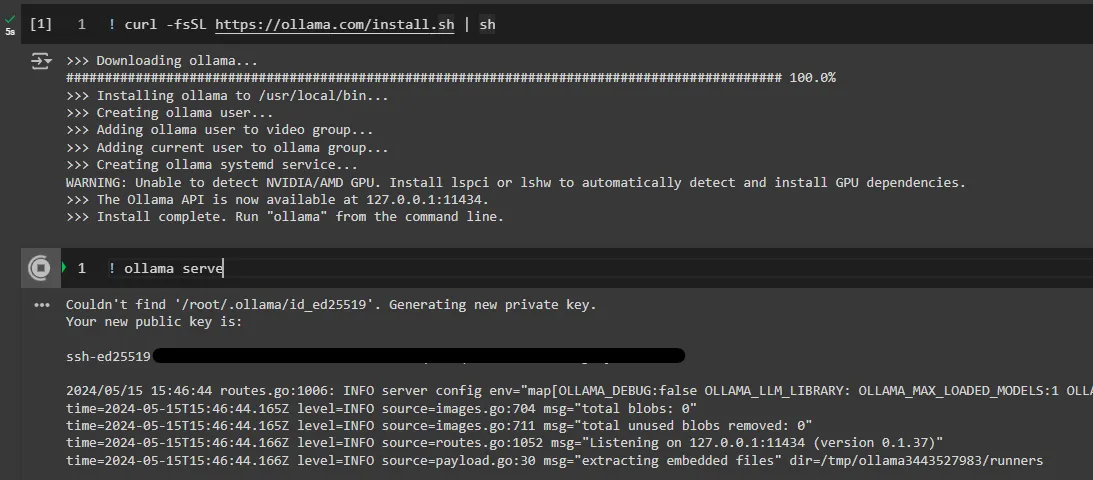

第4步:安装 Ollama 注:Ollama 需要根据上下文解释其含义或相关性。在出现的终端中,输入以下命令来安装 Ollama:

<命令> curl -fsSL https://ollama.com/install.sh | sh此命令会下载并执行 Ollama 的安装脚本。

步骤五:启动 Ollama 服务

安装完成后,运行命令启动Ollama服务器即可。

启动 ollama serve 命令并在后台运行(&)在末尾加上 & 可以让服务器在后台运行,这样你就可以继续使用终端了。

步骤 6:获取 Ollama 模型

现在 Ollama 服务器正在运行中,你可以下载你选择的模型。例如,要下载 Llama 2 模型,请运行:

ollama pull llama2将 llama2 替换为你想用的任何其他模型名称。

步骤 7:将 Ollama 集成到 LangChain 中

要使用 Ollama 与 LangChain 配合,一个广受好评的处理语言模型的框架,我们需要安装 LangChain 社区提供的包。

!pip install langchain_community # 安装 langchain_community 扩展包为了确保LangChain能与我们的Ollama服务器通信,我们需要设置一个环境变量。

import os

os.environ['OLLAMA_HOST'] = '127.0.0.1:11434' # 设置OLLAMA_HOST环境变量为本地地址现在我们可以通过LangChain来使用Ollama了。下面就是一个简单的例子。

from langchain_community.llms 导入 Ollama

# 初始化Ollama模型如下

llm = Ollama(model="llama2")

# 生成响应如下

response = llm.invoke("用简单的语言解释一下什么是人工智能。")

print(response)这段代码启动Llama 2模型并生成提示内容的回应。

最佳实践和小技巧在 Google Colab 上运行 Ollama 时,请参考以下建议:

- GPU 加速:确保选择 GPU 运行时以获得更好的性能。转到 Runtime > 更改运行时类型 并选择 GPU 作为硬件加速器。

- 模型选择:选择符合 Colab 内存限制的模型。较小的模型,如 Llama 2 7B 更有可能顺利运行,而较大的变体则不太可能运行顺畅。

- 会话管理:Colab 会话有时间限制,可能会断开连接。请定期保存您的工作,并准备好在必要时重启运行时。

- 资源监控:注意 Colab 中的 GPU 内存使用情况。您可以在笔记本右上角的 RAM 和 GPU 监控小部件中查看这些信息。

- 尝试不同模型:Ollama 支持多种模型。尝试不同的模型,找到最适合您任务的那个。

现在你对基本设置已经很熟悉了,我们来看看在 Google Colab 上 Ollama 更高级的用法,还有实际运行的代码示例。

调整模型虽然 Ollama 主要专注于推理,我们也可以将从 Ollama 获取的模型作为特定任务微调的起点。这里有一个在自定义数据集上微调小语言模型的具体例子:

!pip install transformers datasets torch # 安装transformers、datasets和torch库

从transformers库导入AutoTokenizer, AutoModelForCausalLM, TrainingArguments, Trainer

从datasets库导入load_dataset

# 从Ollama加载一个名为'tinyllama'的小模型

model_name = "tinyllama"

!ollama pull {model_name}

# 加载模型和分词器

tokenizer = AutoTokenizer.from_pretrained(f"ollama/{model_name}")

model = AutoModelForCausalLM.from_pretrained(f"ollama/{model_name}")

# 准备一个样本数据集(请用你自己的数据集替换此数据集)

dataset = load_dataset("wikitext", "wikitext-2-raw-v1", split="train")

def tokenize_function(examples):

return tokenizer(examples["text"], truncation=True, padding="max_length", max_length=128)

tokenized_dataset = dataset.map(tokenize_function, batched=True)

# 设置训练参数如下

training_args = TrainingArguments(

output_dir="./results",

num_train_epochs=3,

per_device_train_batch_size=4,

save_steps=10_000,

save_total_limit=2,

)

# 初始化Trainer对象

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_dataset,

)

# 开始微调模型

trainer.train()

# 保存微调后的模型到本地目录

trainer.save_model("./fine_tuned_model")此脚本在一个WikiText数据集的子集上对一个小型语言模型进行了微调。您可以将数据集替换为自己的,来进行特定任务的微调。

集成其他库我们来把Ollama和流行的NLP库(如spaCy和NLTK)集成起来。

!pip install spacy nltk langchain_community # 安装必要的库

!python -m spacy download en_core_web_sm # 下载英文模型 import spacy

import nltk

from langchain_community.llms import Ollama

from nltk.tokenize import word_tokenize

nltk.download('punkt')# 初始化Ollama模型

llm = Ollama(model="llama2")# 使用Ollama生成文本

text = llm.invoke("解释自然语言处理为何重要。")# 使用spaCy处理

nlp = spacy.load("en_core_web_sm")

doc = nlp(text)

print("命名实体识别结果:")

for ent in doc.ents:

print(f"{ent.text}: {ent.label_}")# 使用NLTK处理

tokens = word_tokenize(text)

print("分词结果(前10个):")

print(tokens[:10]) # 显示前10个分词这个示例演示了如何使用Ollama生成文本内容,然后使用spaCy识别命名实体,使用NLTK进行分词。

构建自定义流水线让我们利用Ollama和LangChain创建一个自定义的问答管道。

从langchain_community.llms导入Ollama模型

从langchain.prompts导入PromptTemplate

从langchain.chains导入LLMChain

# 初始化Ollama模型

llm = Ollama(model="llama2")

# 创建一个用于问答的提示模板

template = """

上下文: {context}

问题: {question}

请基于提供的上下文,简洁回答以下问题:

回答: """

prompt = PromptTemplate(template=template, input_variables=["context", "question"])

# 创建一个LLMChain

qa_chain = LLMChain(llm=llm, prompt=prompt)

# 示例用法

context = "Python编程语言是由Guido van Rossum创建的,并于1991年首次发布。它以其简洁性和可读性而闻名。"

question = "谁创建了Python,它是什么时候首次发布的?"

# response = qa_chain.invoke({"context": context, "question": question})

# print(response['text'])这个流程以上下文和问题作为输入,然后使用LangChain中的Ollama模型生成一个答案。

难题和局限让我们通过代码示例来应对一些实际挑战:

资源监视查看Colab中的图形处理器使用情况。

!nvidia-smi定期运行此命令来检查GPU内存使用情况,并确保没有超出限制。

处理会话中断的情况为了处理可能的会话中断,您可以定时保存模型状态,例如:

import os

from transformers import AutoModelForCausalLM, AutoTokenizer

def save_model_state(model, tokenizer, path):

if not os.path.exists(path):

os.makedirs(path)

model.save_pretrained(path)

tokenizer.save_pretrained(path)

# 每1000步就存一下模型,方便训练时用

if step % 1000 == 0:

save_model_state(model, tokenizer, f"./checkpoint_{step}")

# 从指定的检查点继续训练

model = AutoModelForCausalLM.from_pretrained("./checkpoint_1000")

tokenizer = AutoTokenizer.from_pretrained("./checkpoint_1000")为了跟踪模型的不同版本:

import json

import datetime

def log_model_version(model_name, description):

log_entry = {

"model_name": model_name,

"timestamp": datetime.datetime.now().isoformat(),

"description": description

}

with open("model_versions.json", "a") as f:

json.dump(log_entry, f)

f.write("\\\\n")

# 法

log_model_version("llama2-finetuned", "在自定义数据集上进行了微调,以提高处理金融文本的效果")此脚本维护了一个 JSON 日志,记录模型的版本及其对应的描述。

结尾通过提供这些实用的代码示例,我们展示了实现高级功能的方法、与其他库进行集成的方式、创建自定义管道的方式以及解决在 Google Colab 上运行 Ollama 时常见的难题。这些动手实践示例将为你打下坚实的基础,以探索更复杂的应用程序,并探索 Ollama 和 Colab 的更多可能性。

记得将这些示例适应到您的具体用例和数据集中。随着您继续实验和开发,您将获得宝贵的经验,了解如何在云环境中使用大型语言模型。祝编程愉快,愿您的AI项目蓬勃发展!

[OOP]:面向对象程序设计

[CRUD]:增删查改

[JVM]:Java虚拟机

[SUT]:待测系统

共同学习,写下你的评论

评论加载中...

作者其他优质文章