今天对LlamaIndex生态系统来说是个大日子:我们今天要宣布的是一款名为LlamaCloud的新产品,这是一款全新的托管解析、摄取和检索服务,旨在为您的LLM和RAG应用程序提供生产级的上下文增强功能。

使用 LlamaCloud 作为企业中的 AI 工程师,你可以专注于编写业务相关的逻辑代码,而无需处理数据。处理大量生产数据,快速提升响应质量。LlamaCloud 发布时包括以下关键组件:

- LlamaParse: 专有的复杂文档解析功能,支持嵌入对象(如表格和图表等)。LlamaParse 直接与 LlamaIndex 的数据摄入和检索集成,让您能够构建复杂、半结构化文档的检索功能。您现在可以回答以前不可能回答的复杂问题,从而实现以前不可能实现的功能。

- 托管摄入和检索 API 功能: 一个允许您轻松加载、处理和存储数据的 API,以任何语言使用的您的 RAG 应用程序。由 LlamaHub 中的数据源(如 LlamaParse)和我们的数据存储集成支持。

LlamaParse 从今天起开放公开预览。它目前支持处理 PDF 文件,但公共使用有额度限制;如有商业合作需求,可联系我们。托管的摄入和检索 API 现已进入私有预览阶段;我们向有限数量的企业合作伙伴开放访问权限。感兴趣的话,请联系我们。(我们还推出了我们网站的新版本,欢迎访问 🦙!)

RAG 只有在数据好的情况下才有效大型语言模型的一个核心承诺是能够自动化地搜索、整合、提取和规划任何非结构化数据。在过去的一年中,为了支持这些增强上下文的LLM应用,一个新的数据栈已经出现并被使用,通常被称为增强检索生成(RAG)。这个栈包括加载、处理和嵌入数据,然后将其加载到向量数据库中。这使得在LLM应用中能够进行下游的检索和提示的协调以提供上下文信息。

这个数据栈和以前的任何 ETL 数据栈都不一样,因为与传统软件不同,数据栈中的每一个决策都会直接影响整个由LLM驱动系统的准确度。例如分块大小和嵌入模型等每个决策都会影响LLM的输出,而且由于LLM具有黑盒特性,你无法通过单元测试确保行为的正确性。

我们过去一年一直在前线努力工作,处于提供工具和教育用户如何构建高性能、高级RAG(检索增强生成)的前沿,以满足各种应用场景。我们的月下载量已超过200万,并被包括Adyen、T-Systems、Jasper.ai、Weights & Biases、DataStax等在内的大公司和初创公司广泛使用。

但是,虽然从我们著名的5行启动示例开始很容易,构建生产级别的RAG仍然是一个复杂且微妙的任务。通过与用户的数百次对话,我们发现最大的痛点在于:

- 结果不够准确: 该应用程序在处理大量输入任务/查询时无法产生令人满意的结果。

- 需要调整的参数太多: 调整参数的数量巨大,不清楚应该调整的是哪些参数,尤其是在数据解析、摄取和检索方面。

- PDF文档特别难以处理: PDF文档尤其难以处理:我有很多复杂且格式混乱的文档。我应该如何正确表示这些文档,以便LLM能够理解?

- 数据同步是一项挑战: 数据同步存在挑战:生产数据会经常更新,持续同步新数据带来了一系列新的挑战。

这是我们用LlamaCloud想要解决的这些问题。

数据管道帮助你顺利进入生产阶段我们构建了 LlamaCloud 和 LlamaParse 作为数据流工具,以更快速地帮助您的 RAG 应用上架。

LlamaParseLlamaParse 是一款最先进的解析工具,专门用于解析包含嵌入表格和图表的复杂 PDF 文件中的 RAG。这在以前是不可能的,我们对此技术感到非常激动。

LlamaParse 示例。给一个 PDF 文件,返回一个保持原文内容和语义的解析成的 Markdown 文件。

过去几个月,我们一直对这个问题非常着迷。这在各种数据类型和垂直领域中是一个出人意料的常见应用,从ArXiv论文到10K披露文件再到医疗报告。

简单的分块和检索算法表现极差。我们首次提出了一种新的递归检索技术(RAG技术),能够对文档中的相关表格和文本进行分级索引和查询。剩下的挑战是如何正确解析文档中的表格和文本。

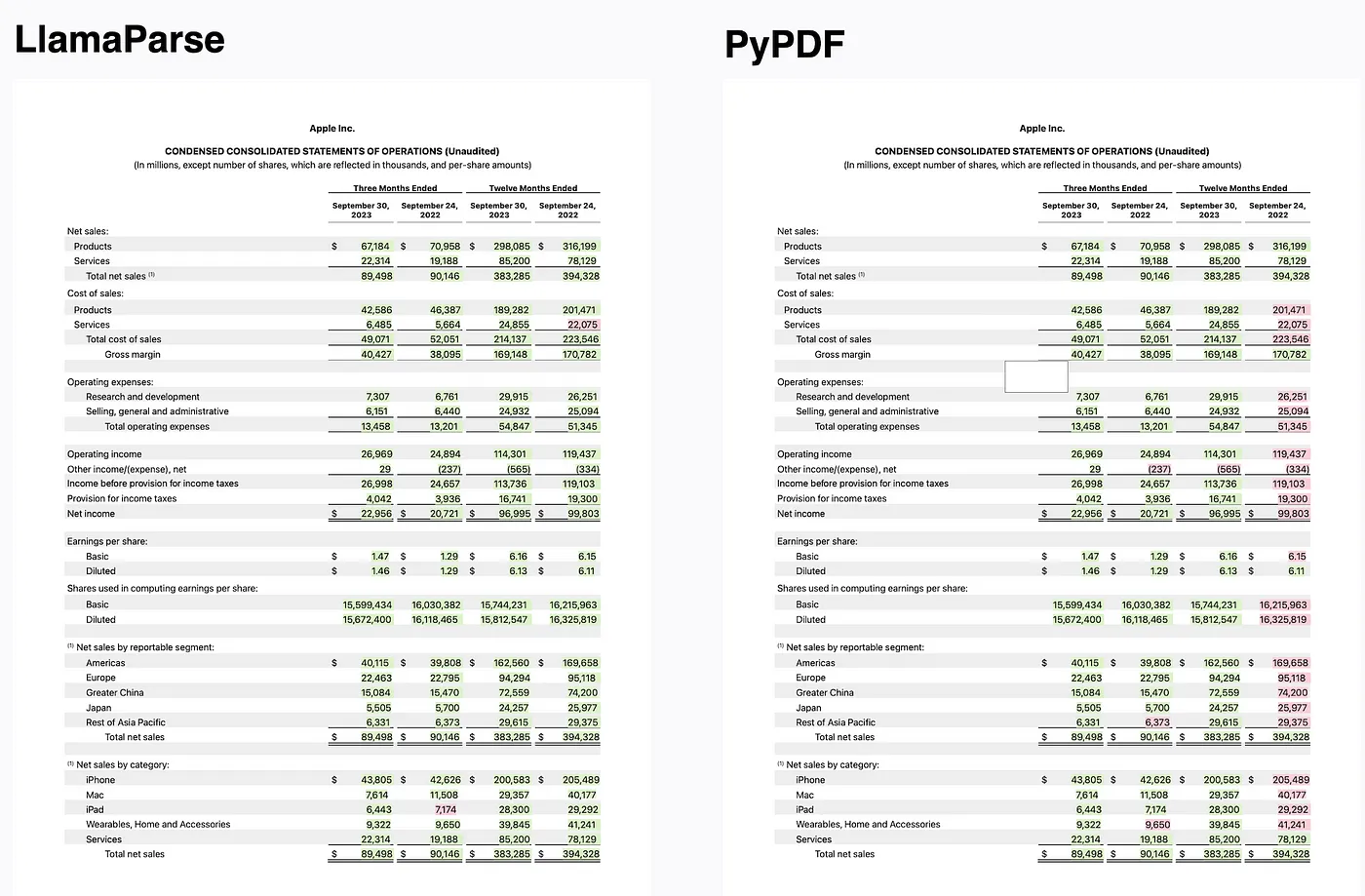

LlamaParse 和 PyPDF 在解析苹果 10K 文件上的比较。完整对比请点击此处。单元格内绿色标记表示 RAG 系统正确回答了该单元格的问题,答案与单元格值相符。红色标记表示 RAG 系统未能正确回答该单元格的问题。

这是LlamaParse发挥作用的地方。我们开发了一项专有的解析服务,能够将包含复杂表格的PDF文件高效地解析为结构良好的Markdown格式。这种表示可以直接与开源库中提供的高级Markdown解析和递归检索算法无缝对接。最终,你可以利用RAG技术处理复杂文档,无论是表格数据还是非结构化数据的问题,它都能给出答案。请参见下方的结果:

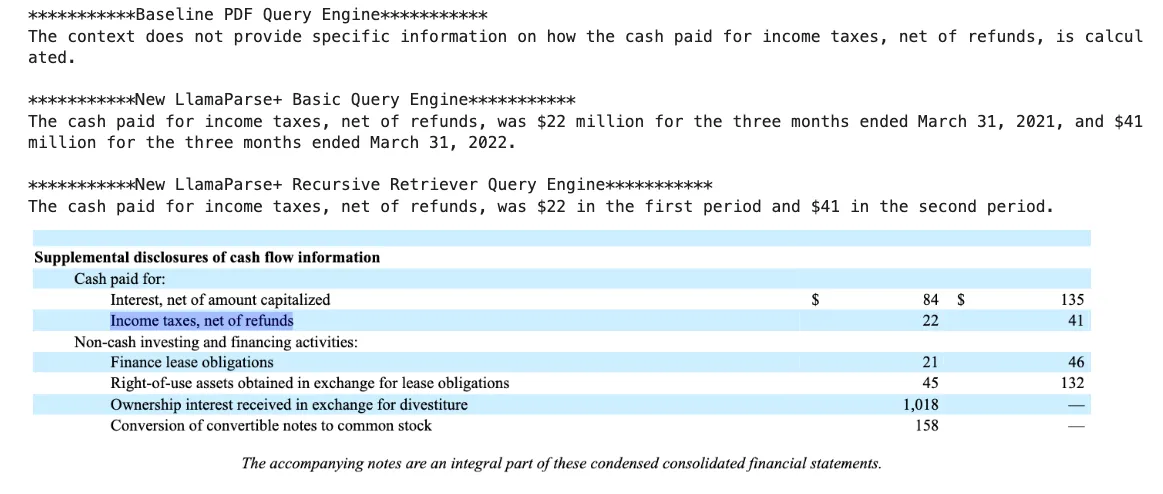

顶部展示了基线PDF方法,而底部则是LlamaParse加高级搜索的比较。

在Uber 10K 数据集 上的结果。更多关于我们的评估指标的信息,请参阅我们在这里的评估页面。

此服务处于公共预览模式:面向所有人,但每天限1000页。它作为一个独立服务运行,同时也可接入我们的托管数据导入和检索API。更多详情请查看我们的LlamaParse 入门。

from llama_parse import LlamaParse

parser = LlamaParse(

api_key="llx-...", # 可以在环境变量中设置为 LLAMA_CLOUD_API_KEY

result_type="markdown", # 支持 "markdown" 和 "text" 两种格式

verbose=True # 详细输出

)如需使用 LlamaParse 的无限商业用途,请联系我们。

下一步:

我们的早期用户已经告诉我们他们希望在接下来的功能中看到什么,并提供了重要的反馈。目前我们主要支持包含表格的 PDF 文件,但我们也正在改进对图表的支持,并扩展对最受欢迎的文档格式的支持,例如:.docx,.pptx,.html。

管理摄取和检索:我们在LlamaCloud还提供了一个易于使用的管理型数据导入和检索API,该API支持高效的数管道定义,适用于任何增强上下文的LLM应用。

获得干净的数据以供您的LLM应用使用,这样您就可以少花时间处理数据,多花时间编写核心应用逻辑。LlamaCloud能帮助企业开发者们,提供以下优势:

- 工程时间节省: 您不再需要编写自定义连接器和解析逻辑,可以直接通过我们的API连接到不同的数据源。

- 性能: 我们为不同数据类型提供了良好的开箱即用性能,并提供了直观的实验、评估和改进路径,方便用户操作。

- 简化系统复杂性: 可以轻松处理具有增量更新的大量数据源。

咱们简单地看看核心组件吧!

- 数据摄取: 声明一个由我们 LlamaHub 中的 150 多个数据源和 40 多个存储集成作为目的地的管理管道来处理并转换/分块/嵌入数据。自动处理同步和负载均衡。您可以通过 UI 或我们提供的开源库进行定义。

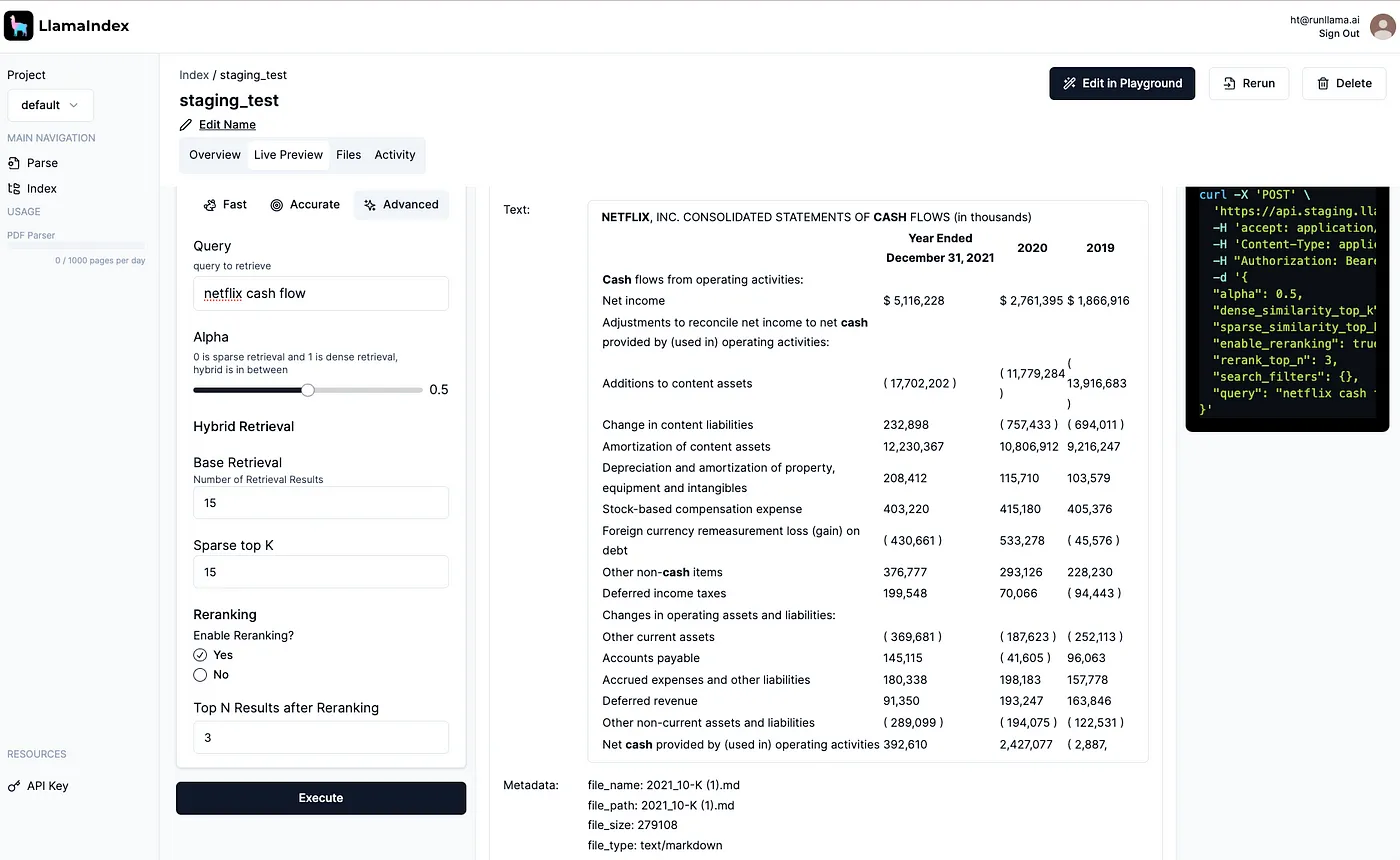

- 检索: 获取由我们开源库和您的数据存储支持的最先进的高级检索服务。将其封装成一个易于使用的 REST API,您可以从任何语言中调用。

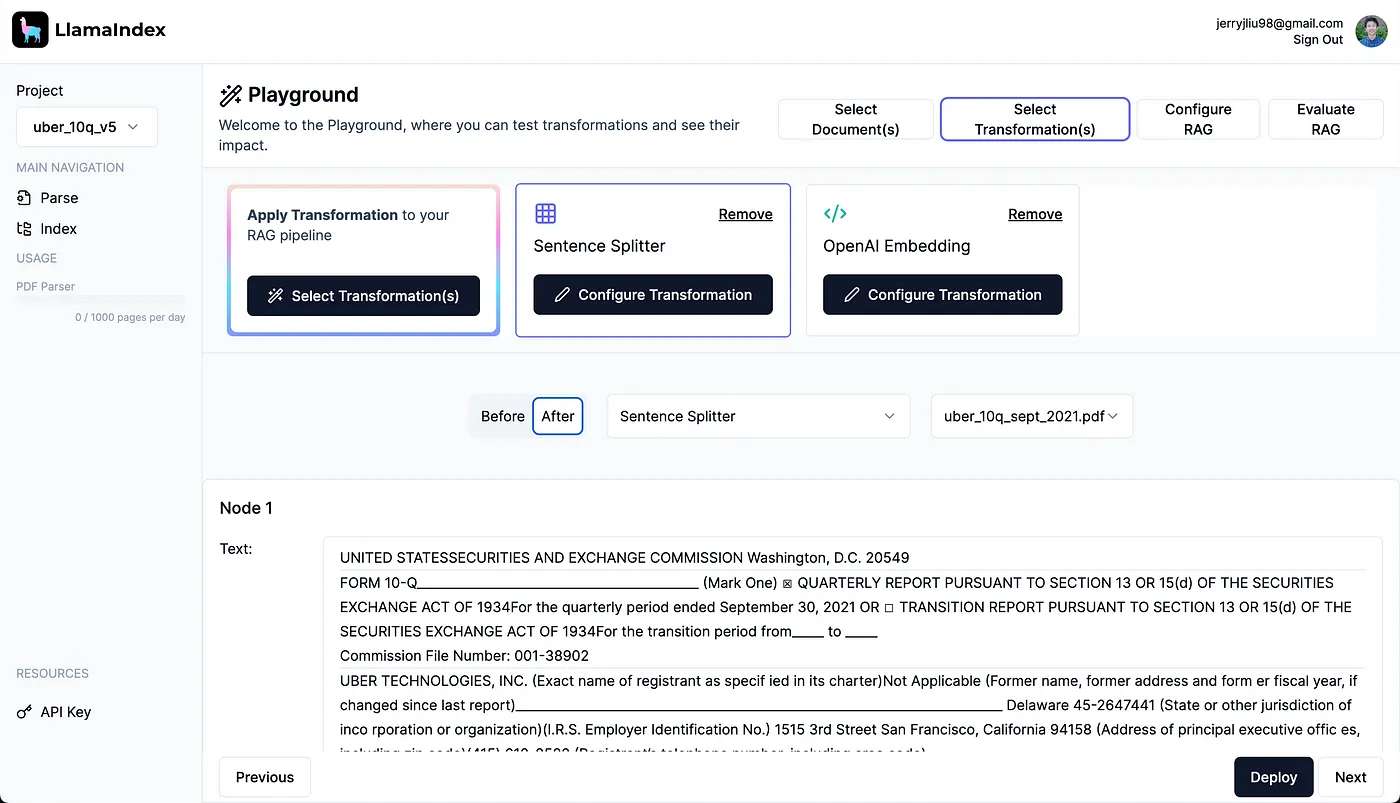

- 实验平台: 在部署前进行测试和优化您的摄取/检索策略,包括评估。

LlamaCloud Playground:配置、评估并优化您的摄取/检索管道,在部署前做好准备工作。

LlamaCloud 检索服务:通过 API 访问您存储系统的高级检索。

我们正在向一组有限的企业合作伙伴开放一个私人测试版,用于管理数据导入和检索的 API。如果您想集中管理您的数据管道,并花更多时间解决实际的 RAG 应用场景,欢迎联系我们。

启动合作伙伴合作者我们在二月初与Futureproof Labs和Datastax联合举办了一场黑客马拉松(rag-a-thon.devpost.com/),并在会上开放了LlamaParse的访问。我们看到了一些令人惊叹的LlamaParse应用案例,比如将建筑规范解析用于附属住宅单元(ADU)规划(blog.llamaindex.ai/pioneering-the-future-of-housing-introducing-genai-driven-adu-planning-ea950be71e2f),以及解析房地产披露以辅助购房(devpost.com/software/home-ai),还有很多其他的应用案例。

埃里克·齐阿尔(Eric Ciarla),Mendable AI 的联合创始人之一,将 LlamaParse 集成到了 Mendable 的数据栈中:“我们将 LlamaParse 集成到了我们的 开源数据连接器仓库(repo),该仓库驱动我们的生产数据导入套件,我们将其称为 LlamaParse。集成起来非常简单,功能也比我们尝试过的任何其他替代方案都更强大。”

我们也非常高兴能与初始合作伙伴和生态系统内的合作者一起参与,从存储到计算的LLM和AI生态圈。

DataStax(DataStax是一家提供数据库解决方案的公司)

Datastax 将 LlamaParse 集成到了他们的 RAGStack 中,为企业的隐私保护提供了一个开箱即用的 RAG 解决方案:“最近,我们的客户 Imprompt 发布了名为 'Chat-to-Everything' 的开创性平台,利用由 LlamaIndex 驱动的 RAGStack 来增强其企业产品,同时注重隐私。”DataStax 的首席技术官兼执行副总裁 Davor Bonaci 说道。“我们非常高兴与 LlamaIndex 合作,为市场带来一个简化的解决方案。通过将 LlamaIndex 集成到 RAGStack 中,我们为企业开发者提供了全面的 Gen AI 堆栈,简化了 RAG 实施的复杂流程,并确保了长期支持和兼容性。”

MongoDB (MongoDB 是一种 NoSQL 数据库)

“MongoDB 与 LlamaIndex 的合作使数据能够被摄入到 MongoDB Atlas 向量数据库中,并通过 LlamaParse 和 LlamaCloud 从 Atlas 中检索索引,从而支持开发 RAG 系统和其他 AI 应用程序,”MongoDB 的全球 AI 生态系统负责人 Greg Maxson 说道。“现在,开发人员可以抽象数据摄入的复杂性,简化 RAG 管道的实现,并更经济高效地开发大型语言模型应用程序,最终加速生成式 AI 应用程序的开发进程,并更快地将应用程序推向市场。”

Qdrant

Qdrant 的首席执行官安德烈·扎亚尔尼非常高兴与 LlamaIndex 合作,这一合作将结合 Qdrant 的优化数据预处理、向量化和数据导入能力,提供一个强大的全栈 RAG 解决方案。

NVIDIA (英伟达)

我们也很激动地与NVIDIA合作,将LlamaIndex集成到NVIDIA AI Enterprise这个用于生产的人工智能软件平台中:“通过连接器将专有数据与大型语言模型的强大功能连接,帮助企业在开发过程中将生成AI应用推进到生产阶段,” NVIDIA企业计算和边缘计算副总裁Justin Boitano表示。“结合LlamaCloud与NVIDIA AI Enterprise可以加速整个大型语言模型的管道——包括数据处理、嵌入创建、索引和在加速计算中的模型推理,这一切都在跨云、数据中心及边缘设备进行。”

FAQ这和向量数据库相比有竞争力吗?

LlamaCloud 主要专注于数据解析和摄入,这为任何向量存储提供商提供了一个互补的层。检索层是在现有存储系统之上的编排。LlamaIndex 开源项目已经整合了 40 多个最受欢迎的向量数据库,我们正在努力做到以下几点:

- 将LlamaCloud与现有设计合作伙伴提供的存储系统集成

- 让LlamaCloud以更“自助式”的方式供用户使用

如上文所述,LlamaParse 今天开始提供公测版本,但有使用上限。LlamaCloud 则处于私密预览模式,我们仅向少数企业设计合作伙伴提供访问权限。有兴趣的话,欢迎来找我们聊聊!

LlamaParse(代码解析工具): Repo, 使用手册, 联系我们页面

LlamaCloud: 如果您有任何问题,欢迎点击这里联系我们的团队 联系我们

共同学习,写下你的评论

评论加载中...

作者其他优质文章